Infra personnelle · couche IA

Ambition massive, exigence maximale

Ici, l’IA est traitée comme une brique d’infra : utile pour corréler, résumer, accélérer — à condition d’être locale quand les données sont sensibles, encadrée quand elle agit sur le système, et validée comme n’importe quel service critique.

LLM local — pourquoi sur une VM dédiée

Un modèle hébergé sur une machine virtuelle dédiée alimente des usages où la confidentialité compte : échanges type chat, brouillons de rapports, assistance à l’analyse de journaux, expérimentations — sans envoyer ces contenus vers un fournisseur SaaS. C’est cohérent avec OpenLLaMA côté services utilisateurs : l’objectif est d’intégrer l’IA au maximum dans le serveur, y compris pour les besoins les plus sensibles. À ne pas confondre avec le bot d’administration, qui utilise l’API Google Gemini — pas ce LLM local.

L’objectif affiché ici : l’IA locale renforce l’infra (assistants, automatisation, rapports, analyse) tout en préservant la maîtrise des données et du périmètre technique.

Dialogue, pas délégation aveugle

Les interfaces « chat » avec un LLM sont utiles pour reformuler, structurer, explorer des chemins — mais la politique de sécurité et les procédures d’exploitation restent humaines. L’outil accélère ; il ne remplace pas la responsabilité sur les changements en production.

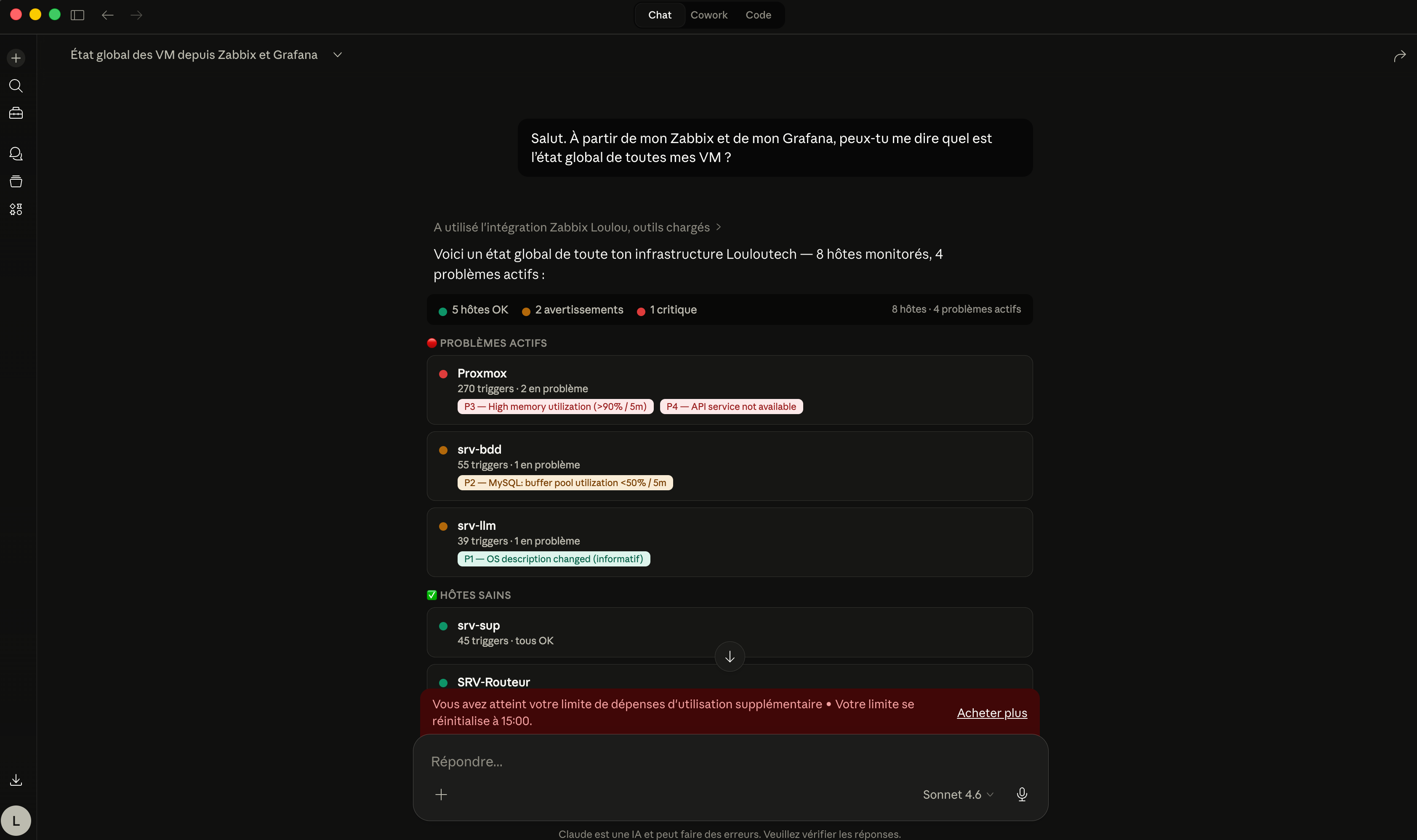

VM serveur MCP & Claude (Anthropic)

Une machine virtuelle dédiée héberge un serveur MCP (Model Context Protocol) : il expose des outils et du contexte aux clients compatibles MCP, ce qui permet de raccorder plusieurs services de l’infra au même bus logique et de les piloter de façon cohérente plutôt que service par service.

Pour l’interface conversationnelle, j’utilise Claude, l’assistant d’Anthropic : en langage naturel, je peux poser des questions, enchaîner des actions et garder le fil sur ce qui est branché au MCP — ce qui rend la gestion et la démonstration nettement plus lisibles qu’une suite de commandes isolées. Ce canal reste distinct du LLM local (OpenLLaMA) et du bot d’administration (Telegram / API Gemini) : ici, l’accent est mis sur l’orchestration MCP et le dialogue avec Claude.

Bot d’administration (phase bêta)

Développé avec Cursor, le bot relie Telegram, l’API Google Gemini (dialogue et raisonnement côté cloud Google) et un ensemble d’actions système encadrées sur le serveur. Il ne passe pas par le LLM local (VM dédiée) : deux canaux d’IA distincts — confidentiel en local, bot admin via Gemini. Déploiement initial sur un serveur isolé pour valider la maturité avant proximité avec l’infra principale.

Principes non négociables

- Utilisateur système dédié, droits stricts — pas de root « par défaut » pour l’IA.

- Copie avant toute modification sensible ; confirmation explicite avant suppressions ou commandes à risque.

- Rapport après action pour voir exactement ce qui a été fait.

- Journalisation et sauvegarde des interactions avec le serveur et l’administrateur.

- Mise en production uniquement lorsque le comportement est prouvé par des tests sévères.

« Un grand pouvoir implique de grandes responsabilités. » — Spiderman, Peter Parker

Innovation mesurée

L’intégration d’outils d’IA locale sert à enrichir les usages (assistants, automatisation, rapports, analyse) sans céder le contrôle sur le serveur. C’est une orientation technique : plateforme évolutive, claire et tenable sur la durée.

Automatisation au sens large

Au-delà du bot : mises à jour testées hors production, sauvegardes planifiées, réplication, intégration progressive des bonnes pratiques. L’automatisation libère du temps pour la conception, la veille et l’amélioration continue — sur une infra personnelle, ce temps est la ressource la plus rare.